✔ 1900년대 후반에 연구되었던 초기의 SLAM 알고리즘은 베이즈(Bayes) 필터에 기반한 방법들이 많이 연구됨.

💡 베이즈 필터

: 로보틱스 분야에서 활용되는 확률 기반의 재귀적인 필터. 사전확률(Prior)과 가능도(Likelihood)로부터 사후확률(Posterior)을 계산하는 베이즈 정리에 기초를 둠.

: 지속적으로 입력되는 주변 환경에 대한 센서 정보, 현재 로봇의 위치 정보를 확률적으로 융합해 로봇의 위치와 주변 환경의 정보를 업데이트하는 알고리즘

✅ 베이즈 필터에 기반한 SLAM 알고리즘 : EKF SLAM(확장칼만필터), Fast SLAM(파티클 필터) 등

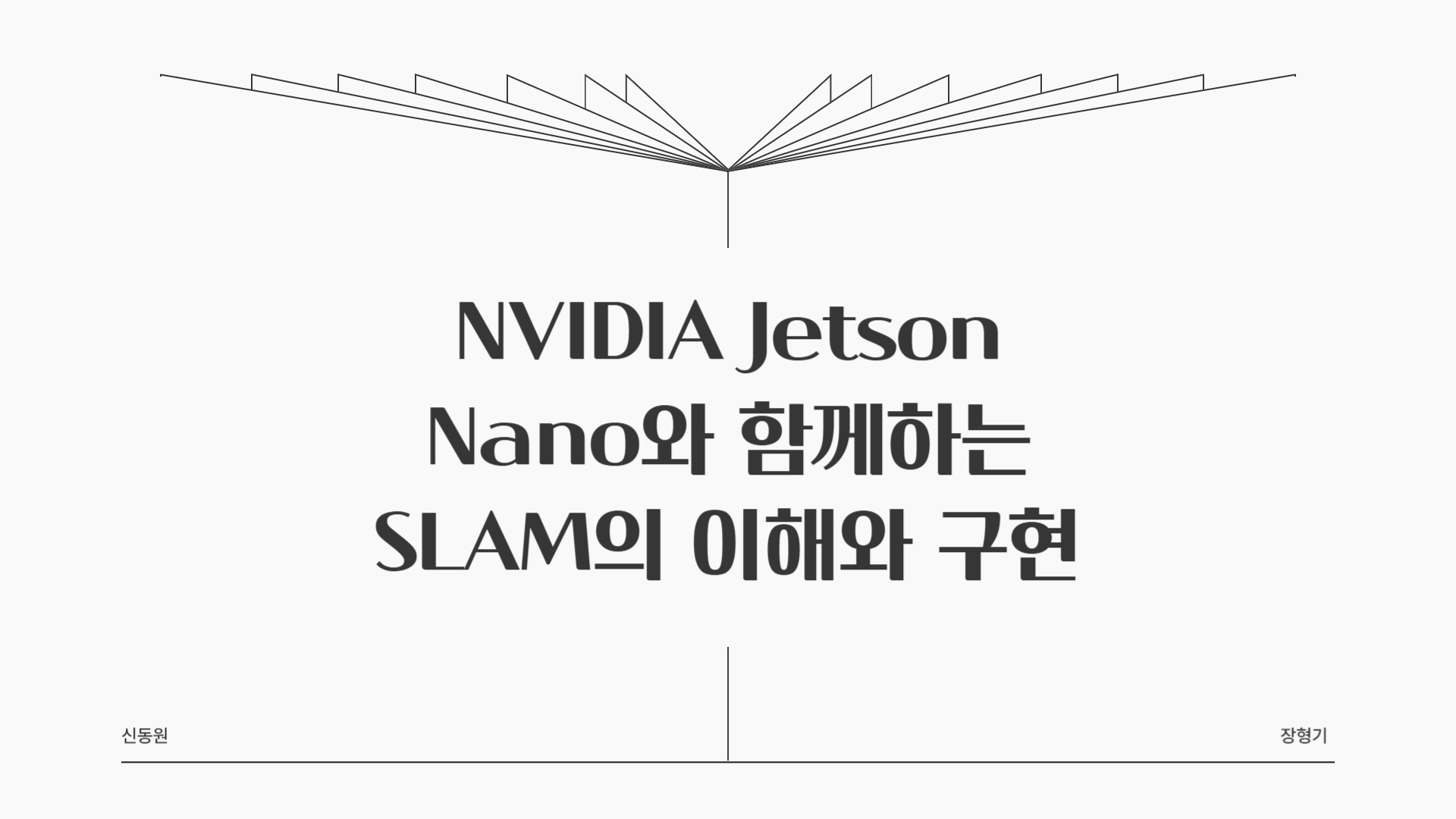

- 빨간색 동그라미 : 로봇의 현재 위치

- 빨간색 선 : 로봇이 이동함에 따라 그려지는 궤적

- 검은색 점 : 로봇-랜드마크 사이 연결 관계

📍 로봇이 공간상을 이동함에 따라, 로봇의 현재 위치에 대한 예측값과 랜드마크의 위치에 대한 측정값이 입력되고, 각각의 사전확률이 가능도와 융합해 로봇의 현재 위치와 랜드마크의 위치에 대한 사후 확률이 업데이트 됨.

📍 그에 대한 결과로 랜드마크 위치에 대한 불확실성이 점점 감소하고, 동시에 로봇의 위치에 대한 불확실성도 감소해 정확한 위치 추정 및 지도 작성을 수행할 수 있게 됨.

✔ 2000년대에 들어서며, SLAM 분야에서는 많은 발전을 거듭해 그래프 구조를 이용한 최적화에 기반을 둔 방법들이 많이 연구되었음.

💡 그래프 최적화 기반 방법

: 로봇의 궤적을 그래프 구조로 표현하고, 제약 조건을 만족하는 형태로 최적화하는 방법

- 그래프 구조 : Node(로봇의 위치), Edge(두 노드 사이의 제약 조건(회전, 이동))

💡 특징점 기반 방법 (Feature based method 또는 indirect method)

: 영상에서 특징점을 기반으로 카메라 궤적을 추적하고, 맵핑을 수행하는 방법

ex) ORB-SLAM

- ORB-SLAM : 영상에서 모서리나 경계면의 특징점을 추출해, 3차원 공간상의 맵포인트를 생성하고 카메라 사이의 특징점 매칭을 통해 상대적인 움직임 정보를 계산해나가는 방법

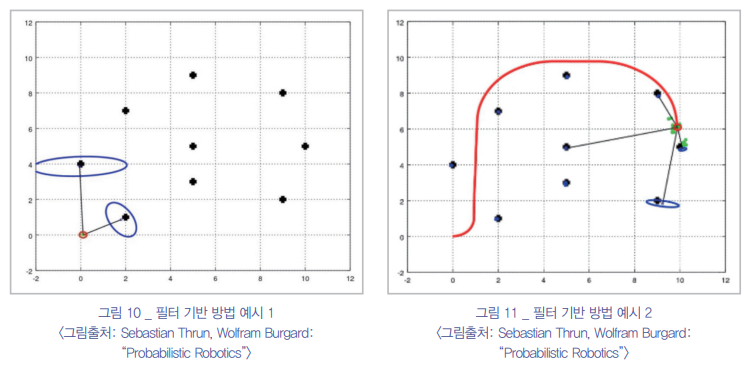

💡 직접 기반 방법 (Direct Method)

: (특징점 기반 방법과 반대) 특징점 없이 영상간의 밝기 값 차이를 직접 이용해 카메라의 궤적 추적, 맵핑 수행

ex) LSD-SLAM

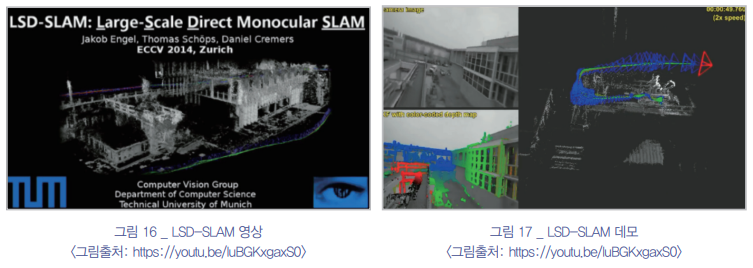

💡 딥러닝 기술의 SLAM 적용

ex) DeeoVO

- 시간순으로 들어오는 연속적인 영상들을 입력으로 받아, 각 영상에 대한 3차원 공간상에서의 카메라 포즈를 계산해 출력함.

- t 시점의 영상을 CNN에 입력해 개별적인 영상에 대한 특징맵을 학습함.

- t 시점과 t+1 시점의 연속된 특징맵에 대해 RNN에 입력해 연속적인 영상에 대한 특징맵을 학습함.

- 그 결과로, 연속적인 영상 사이의 상대적인 움직임을 결과로 출력하게 되고, 이 결과가 사전에 주어지는 정답 데이터와의 차이가 최소가 되는 방향으로 전체적인 신경망이 학습됨.

✅ 이 연구는 초기 연구라 기존의 전통적인 SLAM 알고리즘과 비교해 떨어지는 모습을 보이고, 학습 데이터가 아닌 데이터에 대해서는 위치 추정을 잘하지 못함.

'🌱 탐구 > 📷 SLAM' 카테고리의 다른 글

| 3-1. SLAM에서 사용하는 센서 소개 (0) | 2024.12.17 |

|---|---|

| 1-5. SLAM의 수학적 정의 (1) | 2024.12.17 |

| 1-4. SLAM 알고리즘의 파이프라인 (0) | 2024.12.17 |

| 1-2. SLAM의 응용 분야 (1) | 2024.12.10 |

| 1-1. SLAM이란? (1) | 2024.12.10 |